AIによる「子供の性的虐待画像」に警鐘 去年だけで27万超の画像など削除 イギリスの団体

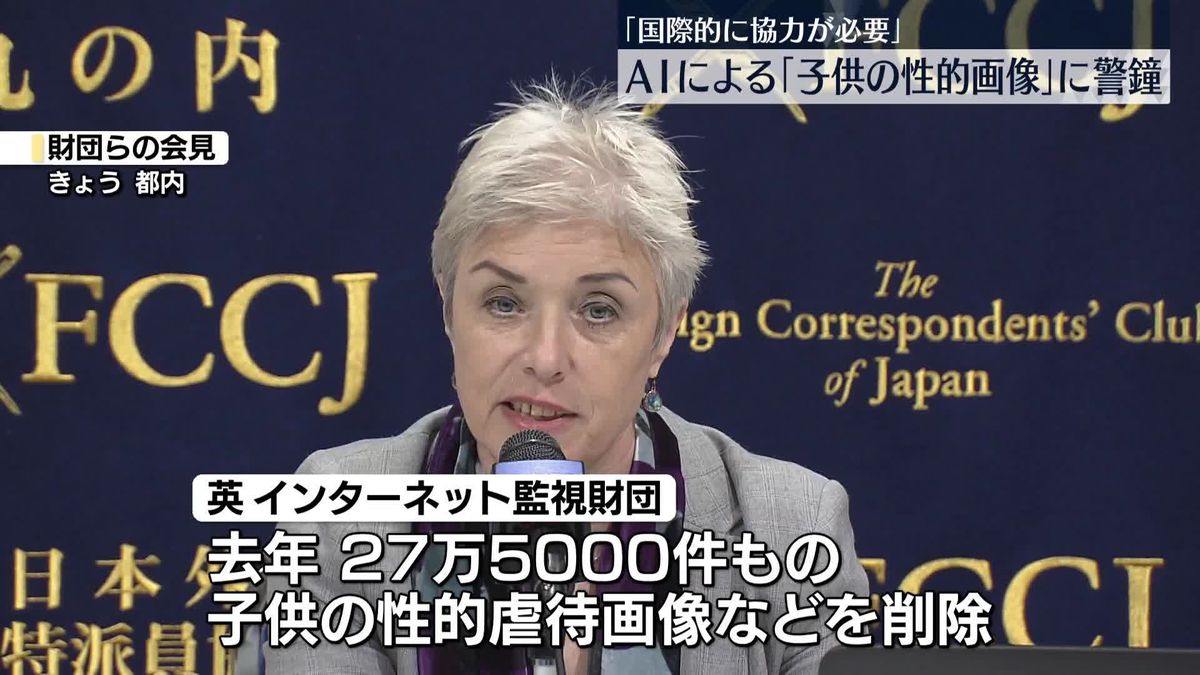

インターネット上での子供への性的虐待画像について調査しているイギリスの団体が会見し、AI=人工知能によるものが急増しているとして、対策を急ぐよう訴えました。

会見した団体は去年、27万5000件もの子供の性的虐待画像などを削除したということです。近年は、AIを使ったものが急激に増えていて、子供が作成し、拡散させるケースもあるといいます。

インターネット監視財団 マイケル・トゥンクス氏「子供がクラスメートの写真を裸に加工して、メッセージングアプリやSNSで拡散させるケースが増えている。ただ、子供たちはこれを作ることが性的虐待であり、違法だと理解していない」

AIを使えば際限なく新たな画像などを作ることが可能になるため、インターネット上で子供を性的に扱ういかなるコンテンツも認めないことが重要だといいます。

インターネット監視財団 スージー・ハーグリーブズCEO「子供が性的虐待される画像などは、ゼロトレランス方式(程度問わず罰する)にすべき。子供は性的な行為に関わるべきではありません。子供たちには普通の子供時代を過ごしてほしいです」

また、法規制について現段階では各国で対応が分かれているが、国際的な協力態勢を構築する必要があると指摘しています。