【解説】「生成AIの利用ガイドライン」公表 他人の論文やデザインをAIで…権利の侵害にあたるか

日本ディープラーニング協会が、AIを利用する際の注意点をまとめたガイドラインを公表しました。その中では、ロゴなどのデザインを生成する際の権利侵害のリスクにも触れています。実際、どのようなことで他人の権利を侵害してしまうのか解説します。

■「生成AIの利用ガイドライン」公表 他人の作品をAIで…権利の問題は?

有働由美子キャスター

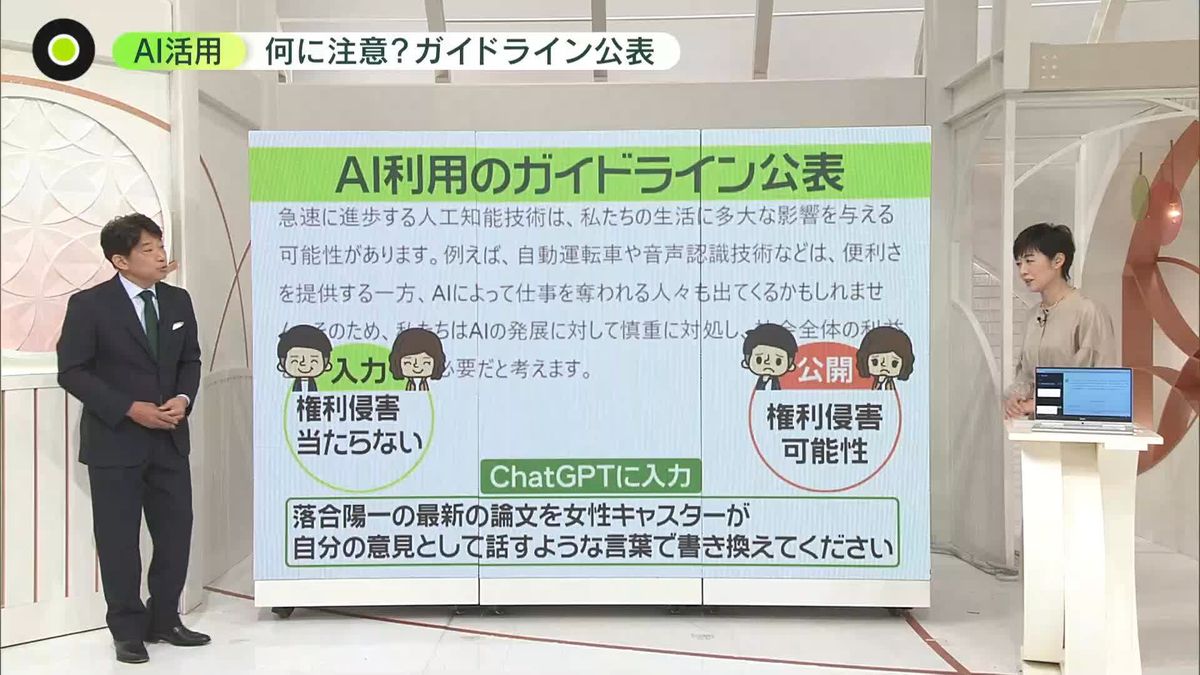

「『チャットGPT』で文章を作成しました。人工知能の進歩について書かれていますが、実は『落合陽一氏の最新の論文を、女性キャスターが自分の意見として話すような言葉で書き換えてください』と入力して作らせたものです。落合さんの論文を勝手に利用した形になりましたので、これを私が使ったら権利の問題は大丈夫なのかと思いますが、こうしたAIを利用する際の注意点をまとめたガイドラインが小野さん、公表されたんですよね」

小野高弘・日本テレビ解説委員国際部デスク

「はい。ガイドラインでは、『入力して作成させること自体は権利の侵害にあたらない』といっています。ただ、出来上がったものが落合さんの論文に似ていて、それを有働さんが作ったものだとして公開することは、権利侵害にあたる可能性があるということです」

有働キャスター

「確かに公開しちゃうと自分でパクったことになりますよね」

小野解説委員

「ということも知っておいた方がいいですよね。それが書かれているのがこのガイドラインで、日本ディープラーニング協会が『チャット型AI』を導入する企業を対象に作成したものですが、私たち個人にも役に立ちます。権利侵害のリスクでいうと、例えば、ロゴをデザインする際に、『入力する時点で“個別のアーティスト名”や“著作物”を入れてはいけません』としています。また、『作られたものが、誰か別の人が作ったものに似ていないか』とも書かれています。例えば、作ったはいいけれど、似たデザインのものがすでに作られていたとしたら、権利の侵害をする可能性があります」

有働キャスター

「『AIが作ったものをそのまま公開すると、危ないケースもあるよ』ということですね」

小野解説委員

「ほかにも『住所や電話番号などの“個人情報”や会社の“機密情報”などは入力しないでください』としています。情報が流出する危険があるからです。また、AIが作った内容は間違っている可能性があるので、必ず根拠や裏付けを自分で確認してくださいということです」